SEOSOON KI-Crawler Analyse: Sperrt Ihr Server KI-Bots aus?

Empirische Analyse der serverseitigen KI-Bot-Blockierung auf 1.444 deutschen Websites | März 2026

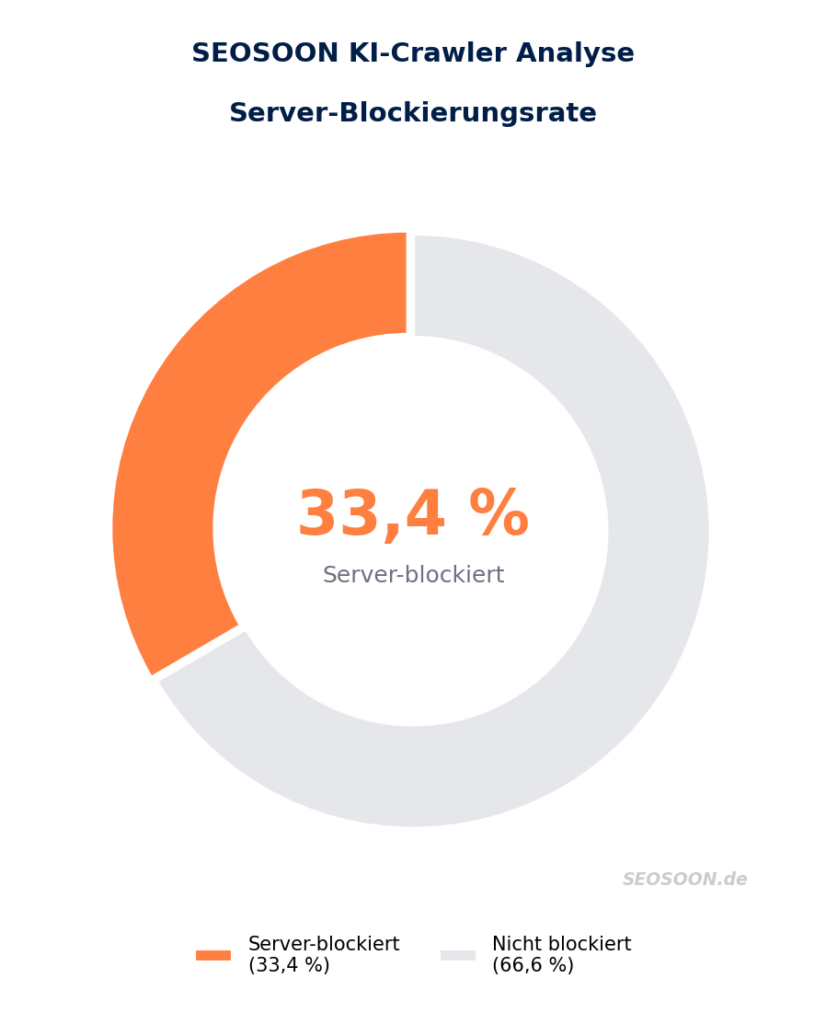

Jede dritte deutsche Website blockiert KI-Bots auf Server-Ebene, ohne dass der Betreiber davon weiß. Das zeigt die SEOSOON KI-Crawler Analyse von 1.444 verifizierten .de-Domains. 33,4 % liefern einen HTTP-Fehlercode an KI-Crawler, während dieselbe Seite über einen normalen Browser problemlos erreichbar ist.

Die zentrale Erkenntnis: Das Muster zeigt auf den Hosting-Provider, nicht auf den Website-Betreiber. 27,5 % aller Domains blockieren ausschließlich Training-Bots per HTTP, Search- und Assistant-Bots kommen durch. Identische Blockierungsprofile bei Dutzenden Domains desselben Providers belegen, dass die Sperre auf Infrastruktur-Ebene greift. Die Zahnärzte, Bäcker und Handwerker dieser Nation merken davon nichts.

Im Fokus der SEOSOON KI-Crawler Analyse stehen die drei relevantesten KI-Anbieter: OpenAI, Anthropic und Perplexity (OAP). Deren Bots werden von den meisten Nutzern eingesetzt und sind für die KI-Sichtbarkeit entscheidend.

Methodik: Was passiert wirklich, wenn ein KI-Bot anklopft?

Die SEOSOON KI-Crawler Analyse misst das tatsächliche Verhalten von Webservern: Jede Domain wurde mit 12 KI-Bot User-Agents und 3 Browser-UAs (Chrome, Firefox, Safari) als Kontrollgruppe abgerufen. Ein Bot gilt als serverseitig blockiert, wenn der Browser Status 200 erhält, der Bot aber einen HTTP-Fehlercode.

1.444 verifizierte .de-Domains aus vier bundesweiten Quellen (Gelbe Seiten, Tranco-Ranking, CommonCrawl, bekannte Listen), manuell per Chrome Extension auf Erreichbarkeit und Echtheit geprüft, 100 % real und erreichbar.

Die 12 getesteten KI-Bots: Training-Bots (GPTBot, ClaudeBot, PerplexityBot, Bytespider, CCBot, Applebot-Extended, Meta-ExternalAgent) scrapen Daten zum Modelltraining. Search-Bots (OAI-SearchBot, Claude-SearchBot) liefern Ergebnisse für KI-Suchmaschinen. Assistant-Bots (ChatGPT-User, Claude-User, Perplexity-User) rufen Inhalte live ab (Grounding). Warum fehlt Google? Gemini nutzt denselben Googlebot wie die klassische Suche, eine separate Blockierung ist technisch nicht möglich.

Ergebnis 1: Jede dritte Website blockiert KI-Bots auf Server-Ebene

482 von 1.444 Domains (33,4 %) blockieren mindestens einen der 12 getesteten KI-Bots serverseitig. Der Server liefert einen HTTP-Fehlercode an den KI-Crawler, über eine normale Browserkennung ist dieselbe Seite problemlos aufrufbar.

| Kennzahl | Domains | Anteil |

|---|---|---|

| Mind. 1 Bot serverseitig blockiert | 482 | 33,4 % |

| Mind. 1 OAP-Bot serverseitig blockiert | 264 | 18,3 % |

| Nur Training-Bots blockiert (Smart Blocking) | 397 | 27,5 % |

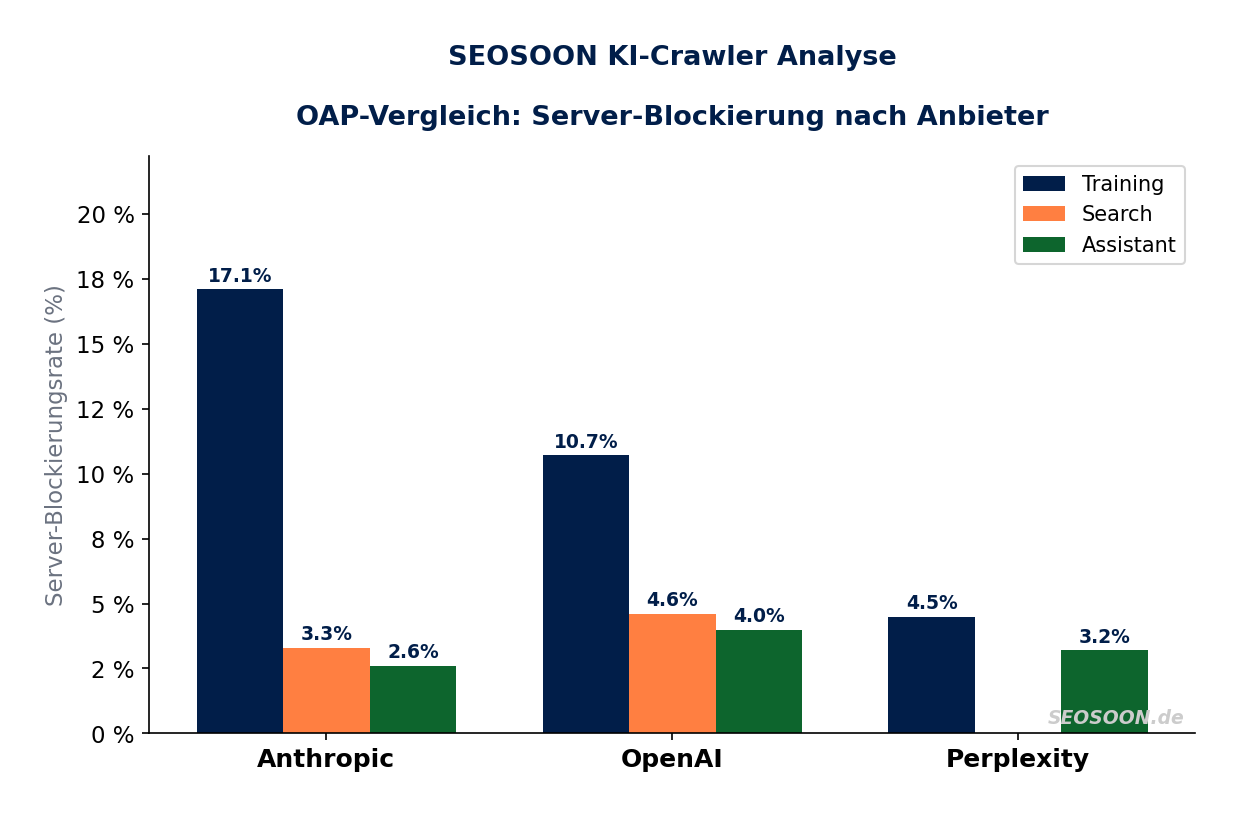

Ergebnis 2: OAP-Analyse – Server-Blocking bei OpenAI, Anthropic und Perplexity

Die SEOSOON KI-Crawler Analyse zeigt erhebliche Unterschiede zwischen den drei OAP-Anbietern. Bei allen werden Training-Bots 3–5× häufiger blockiert als Assistant-Bots.

(mind. 1 Bot Server-blockiert)

(mind. 1 Bot Server-blockiert)

(mind. 1 Bot Server-blockiert)

| Anbieter | Training | Search | Assistant | Mind. 1 Bot |

|---|---|---|---|---|

| Anthropic | 17,1 % | 3,3 % | 2,6 % | 17,3 % |

| OpenAI | 10,7 % | 4,6 % | 4,0 % | 11,3 % |

| Perplexity | 4,5 % | – | 3,2 % | 4,6 % |

ClaudeBot wird 60 % häufiger serverseitig blockiert als GPTBot (17,1 % vs. 10,7 %). Perplexity wird am seltensten serverseitig blockiert, möglicherweise weil PerplexityBot noch weniger bekannt ist und seltener in Provider-Blocklisten auftaucht.

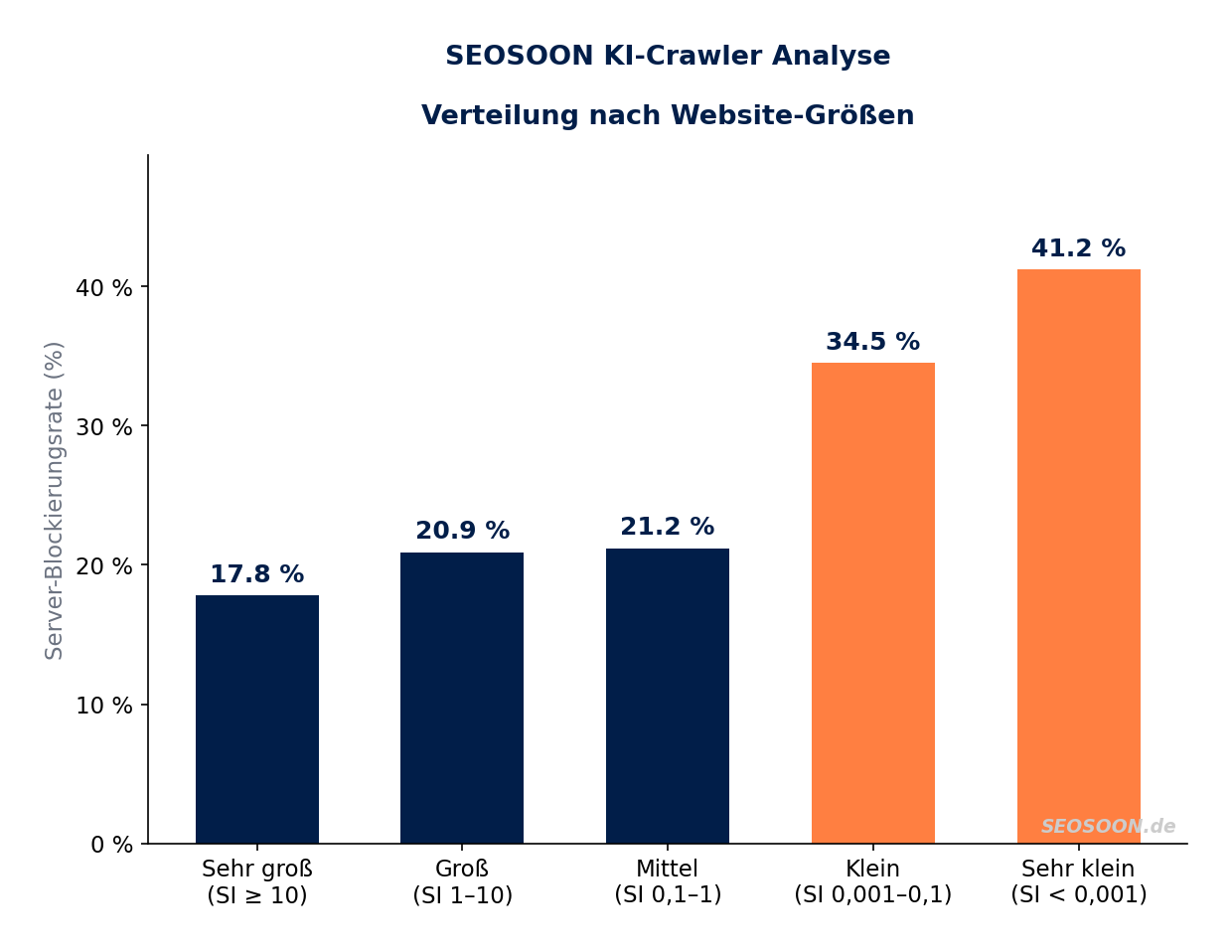

Verteilung nach Website-Größen

Die SEOSOON KI-Crawler Analyse zeigt einen klaren Zusammenhang zwischen Website-Größe und serverseitiger Blockierung:

Je kleiner die Website, desto häufiger die Server-Blockierung. Bei sehr kleinen Domains, den Zahnarztpraxen, Bäckereien und Handwerksbetrieben, liegt die Rate bei 41,2 %. Diese Websites nutzen typischerweise Shared-Hosting-Pakete, bei denen der Provider KI-Bot-Blocking auf Infrastruktur-Ebene konfiguriert hat. Die Betreiber wissen in der Regel nicht, dass ihre Inhalte für ChatGPT, Claude und Perplexity unsichtbar sind.

Bei sehr großen Domains liegt die Rate mit 17,8 % deutlich niedriger. Das bedeutet nicht, dass KI-Bots dort willkommen sind, große Publisher und Konzerne setzen auf differenziertere Mechanismen wie IP-Whitelisting (z.B. im Rahmen von Lizenzvereinbarungen), Bot-Detection und Rate-Limiting.

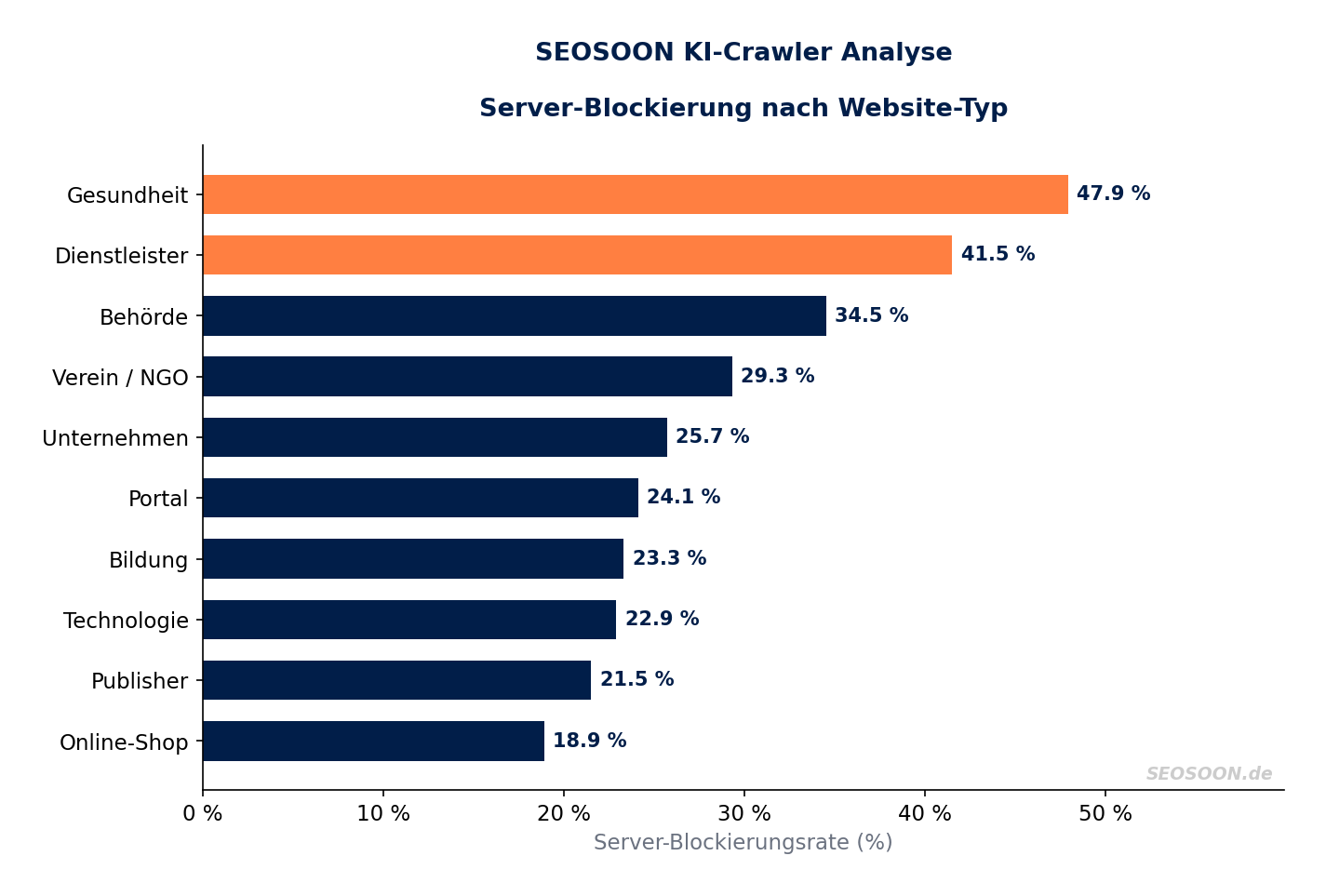

Gesundheit und Dienstleister am stärksten betroffen

Gesundheits-Websites (47,9 %) und Dienstleister (41,5 %) sind am stärksten serverseitig blockiert, genau die Branchen, die typischerweise Shared-Hosting nutzen und deren Betreiber sich nicht aktiv mit KI-Bot-Management beschäftigen.

Publisher liegen mit 21,5 % unter dem Durchschnitt, sie blockieren primär bewusst per robots.txt. Inklusive robots.txt steigt ihre Rate auf 73,3 %. Online-Shops blockieren am wenigsten (18,9 %), Produkt-Content in KI-Ergebnissen ist erwünscht.

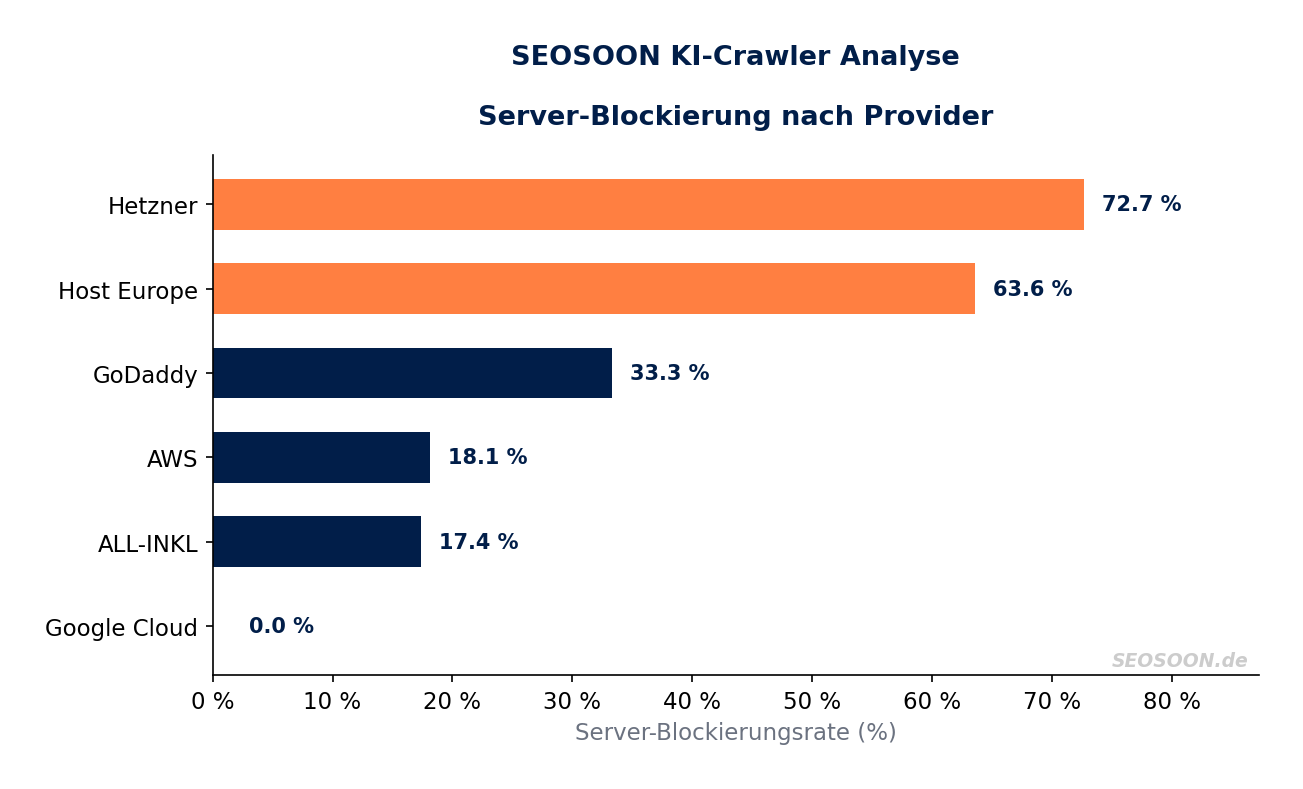

Provider-Ranking – wer sperrt auf Infrastruktur-Ebene?

Wenn Dutzende Domains beim gleichen Provider das exakt identische Blockierungsprofil zeigen, ist die Sperre nicht individuell konfiguriert, sondern global durch den Provider eingerichtet.

| Provider | Domains | Server-blockiert |

|---|---|---|

| Hetzner | 55 | 72,7 % |

| Host Europe | 11 | 63,6 % |

| GoDaddy | 9 | 33,3 % |

| AWS | 72 | 18,1 % |

| ALL-INKL | 46 | 17,4 % |

| Google Cloud | 23 | 0,0 % |

Hetzner (72,7 %) und Host Europe (63,6 %) stechen heraus, hier blockiert der Provider, nicht der Betreiber. Bei Google Cloud dagegen 0 % Server-Blocking, dort erfolgen Blockierungen ausschließlich bewusst per robots.txt.

Fazit: KI-Sichtbarkeit beginnt beim Server

Die SEOSOON KI-Crawler Analyse zeigt ein zweigeteiltes Bild der deutschen Website-Landschaft:

Große Websites und Publisher treffen bewusste Entscheidungen über den KI-Zugang. Sie blockieren per robots.txt, verhandeln Lizenzvereinbarungen und setzen IP-Whitelisting ein. Ob und welche Bots Zugang erhalten, ist eine strategische Entscheidung.

Kleine und mittlere Websites, die Zahnärzte, Bäcker, Handwerker und lokalen Dienstleister, werden hingegen oft ohne ihr Wissen blockiert. Ihr Hosting-Provider hat KI-Bot-Blocking auf Infrastruktur-Ebene aktiviert und sie merken nicht, dass ihre Inhalte für ChatGPT, Claude und Perplexity unsichtbar sind. In einer Welt, in der KI-Sichtbarkeit zunehmend geschäftsrelevant wird, ist das ein Problem.

Unsere Empfehlung:

- Server prüfen: Teste, ob KI-Bots deine Website tatsächlich erreichen. Entscheidend ist der HTTP-Statuscode, nicht die robots.txt.

- Provider kontaktieren: Frag gezielt nach KI-Bot-Blocking. Hetzner, Host Europe und andere Provider blockieren auf Infrastruktur-Ebene.

- Differenziert entscheiden: Training-Bots und Assistant-Bots sind nicht dasselbe. Wer in KI-Ergebnissen sichtbar sein will, sollte zumindest die Assistant-Bots (ChatGPT-User, Claude-User, Perplexity-User) durchlassen.

Inklusive bewusster robots.txt-Blockierung sind es sogar 40 % aller deutschen Websites, die mindestens einen KI-Bot aussperren. Manche werden dabei kreativ: qvc.de antwortet KI-Crawlern mit dem HTTP-Statuscode 418 – „I’m a Teapot“, einem Easter Egg aus den 90ern. Die vollständige Analyse mit allen Ergebnissen, Provider-Details und 15 identifizierten Statuscodes findest du in der SEOSOON KI-Crawler Analyse.

Einen Auszug der Ergebnistabelle mit 140 Beispiel-Domains und den Ergebnissen aller 5 Testläufe haben wir ebenfalls veröffentlicht.

Wird deine Website von KI-Bots erreicht?

Teste jetzt kostenlos, ob ChatGPT, Claude & Co deine Inhalte lesen können oder ob dein Server sie blockiert.

Zum KI Bot-CheckerÜber die SEOSOON KI-Crawler Analyse: Die Datenerhebung wurde im März 2026 von SEOSOON.de durchgeführt. Alle Rohdaten sind verfügbar. Bei Fragen oder für die Nutzung der Daten in eigenen Publikationen kontaktiere uns gerne unter seosoon.de/kontakt.

Zitierweise: Bettinga, J. (2026). SEOSOON KI-Crawler Analyse: Serverseitige Bot-Blockierung auf deutschen Websites. seosoon.de. https://seosoon.de/studie/ki-bot-blocking-studie-2026/